GPTを自作して大規模言語モデルを理解する:PythonでTransformerとAttentionを学ぶLLM機械学習

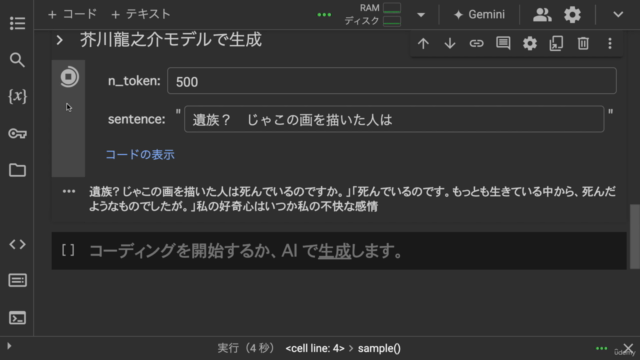

GPT1の部品を作りながらPyTorchでGPT本体を自作します。LLMがどのように作用しているのか本体を自作してコードレベルで見ていきます。レクチャーの内容に応じてニューラルネットワークについても触れていきます。

4.48 (126 reviews)

1,747

students

7.5 hours

content

Mar 2025

last update

$39.99

regular price

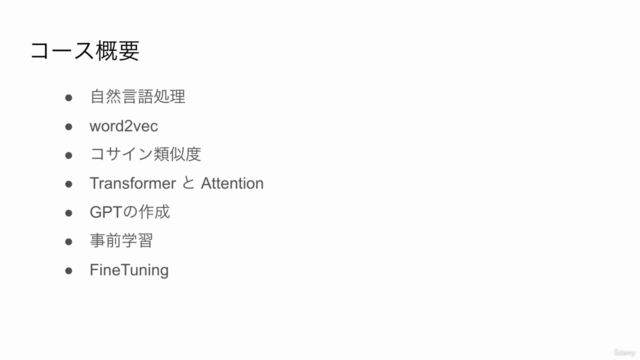

What you will learn

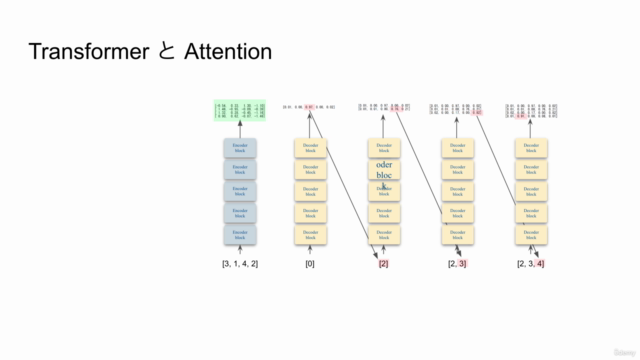

TransformerのAttentionメカニズムとGPTの仕組みを学びます。

自然言語処理の流れを学びます。

Python言語を学びながらGPTのプログラムを作ります。

機械学習フレームワーク、PyTorchを教材として学びます。

Screenshots

5712260

udemy ID

12/15/2023

course created date

4/24/2024

course indexed date

Bot

course submited by